關於強化學習的專業插圖

老虎機算法入門

老虎機算法入門

如果你有玩過現代老虎機或者研究過機器學習,你可能聽過多臂老虎機問題(Multi-Armed Bandit Problem)。呢個問題其實係一個經典嘅試錯型學習模型,專門用嚟解決資源分配同決策優化嘅難題。簡單嚟講,想像你面前有幾部老虎機(即係bandits算法中嘅「臂」),每部機嘅中獎概率分佈都唔同,但你唔知邊部機嘅期望值最高。咁點樣先可以用最少嘅成本(例如時間或金錢)搵出最賺錢嘅老虎機呢?呢個就係多臂老虎機要解決嘅核心問題。

喺2025年,強化學習領域最常用嘅幾種算法包括UCB算法(Upper Confidence Bound,上置信界算法)、Thompson Sampling(湯普森採樣算法)同ϵ-貪婪算法(epsilon-greedy)。每種方法都有佢嘅優勢同適用場景,例如:

- UCB1算法:基於霍夫丁不等式,通過計算置信上限嚟平衡探索(試新機)同開發(玩已知高回報機)。UCB特別適合無狀態的強化學習,因為佢唔需要預先知道概率分佈,純靠數據驅動。

- Thompson Sampling:利用蒙特卡洛採樣同伯努利分佈,隨機模擬每部機嘅中獎概率,再選擇最有可能贏錢嘅機。呢種方法喺在線廣告推薦同醫療試驗中好受歡迎,因為佢能快速收斂到最佳選擇。

- ϵ-貪婪算法:設定一個細概率(例如ϵ=0.1)隨機探索新選項,其他時間就玩當前已知最好嘅機。雖然簡單,但容易陷入局部最優,所以通常會配合衰減ϵ值嚟改進。

如果想深入比較呢啲算法,可以睇吓佢哋嘅累積懊悔(Regret)同平均獎勵。例如,UCB1喺長期表現穩定,但初期探索成本較高;Thompson Sampling喺小樣本時表現更靈活,尤其適合動態環境。另外,進階版嘅LinUCB算法仲可以處理上下文信息(Contextual Bandits),例如根據玩家行為動態調整老虎機賠率。

實際應用上,數據驅動嘅老虎機算法已經唔止用喺賭場。例如電商平台會用佢嚟做A/B測試,快速找出最高轉化率嘅廣告版本;遊戲公司亦會用嚟優化關卡難度,確保玩家留存率。關鍵在於點樣平衡統計置信與即時收益——玩得太保守可能錯失機會,太進取又會浪費資源。

最後提一提,選擇算法時要考慮問題特性:如果環境變化快(例如股票市場),Thompson Sampling嘅適應性會比UCB更好;如果資源有限(例如預算少嘅初創),ϵ-貪婪可能更實際。記住,冇「最好」嘅算法,只有「最適合」嘅算法!

關於多臂老虎機的專業插圖

期望值計算教學

期望值計算教學:點樣用統計學同機器學習破解老虎機算法?

喺多臂老虎機問題入面,期望值(Expected Value)係決定揀邊部機嘅核心指標。簡單講,期望值就係長期拉霸嘅平均獎勵,計法係將每個選項嘅獎勵乘以其概率再相加。例如一部現代老虎機有60%機會出10蚊、40%機會出0蚊,咁期望值就係 0.6×10 + 0.4×0 = 6蚊。但現實中老虎機嘅概率分佈係隱藏嘅,點樣用數據驅動方法估算呢?

1. 用伯努利分佈同蒙特卡洛採樣模擬

如果老虎機嘅獎勵係二元結果(贏/輸),可以用伯努利分佈建模。假設你玩咗某部機100次,贏咗30次,咁贏錢概率嘅估計值係30%(即平均獎勵)。但呢個估計可能唔準,尤其數據少時。湯普森採樣算法(Thompson Sampling)就係用蒙特卡洛採樣,從概率分佈中隨機抽樣嚟平衡探索(試新機)同開發(揀高獎勵機)。例如:每次先從Beta分佈抽一個概率值,再揀抽到最高值嘅機,咁就自然兼顧咗統計置信同即時回報。

2. 點用UCB1算法計置信上限?

上置信界算法(UCB1)直接將期望值加上一個「不確定性項」,公式係:

UCB = 平均獎勵 + √(2×ln(總嘗試次數)/該機嘗試次數)

後半部分基於霍夫丁不等式,代表數據不足時嘅調整。例如:A機玩10次平均獎勵5蚊,B機玩2次平均8蚊,UCB1會揀B機,因為佢嘅高不確定性可能隱藏更高潛力。相比之下,ϵ-貪婪算法(epsilon-greedy)就簡單啲:大部分時間揀當前最佳機(開發),但有ϵ概率隨機探索,缺點係可能浪費次數喺明顯差嘅選項。

3. 實際例子:LinUCB點處理動態環境?

傳統老虎機假設獎勵分佈固定,但現代老虎機可能因活動或玩家行為改變。LinUCB算法將獎勵建模為特徵(如時間、投注額)嘅線性組合,動態更新期望值。例如:某機喺周末平均獎勵升20%,LinUCB會快速調整權重,減少累積懊悔(Regret)。呢種方法屬於無狀態的強化學習,適合處理非靜態概率分佈。

4. 點樣避免試錯型學習嘅陷阱?

新手常犯錯係太早鎖定一部機,忽略統計學上嘅置信區間。建議:

- 頭20次試勻所有機,確保每部有基本數據

- 用湯普森採樣或UCB1等平衡探索與開發

- 定期重估期望值,尤其當獎勵波動大時

5. 進階技巧:點用累積懊悔評估算法?

累積懊悔(Cumulative Regret)係比較算法好壞嘅指標,計法係「理論最佳獎勵」減「實際獲得獎勵」。例如:最佳機期望值10蚊,你用UCB1玩100次拎到900蚊,懊悔就係 100×10 - 900 = 100蚊。實測中,Thompson Sampling通常懊悔增長最慢,因為佢嘅概率分佈更新更貼近真實數據。

小貼士:如果想實戰練習,可以試吓用Python嘅numpy模擬多臂老虎機環境,比較唔同算法(如epsilon-greedy vs UCB1)嘅平均獎勵曲線。記住,關鍵唔係追求單次爆彩,而係長期最大化期望值!

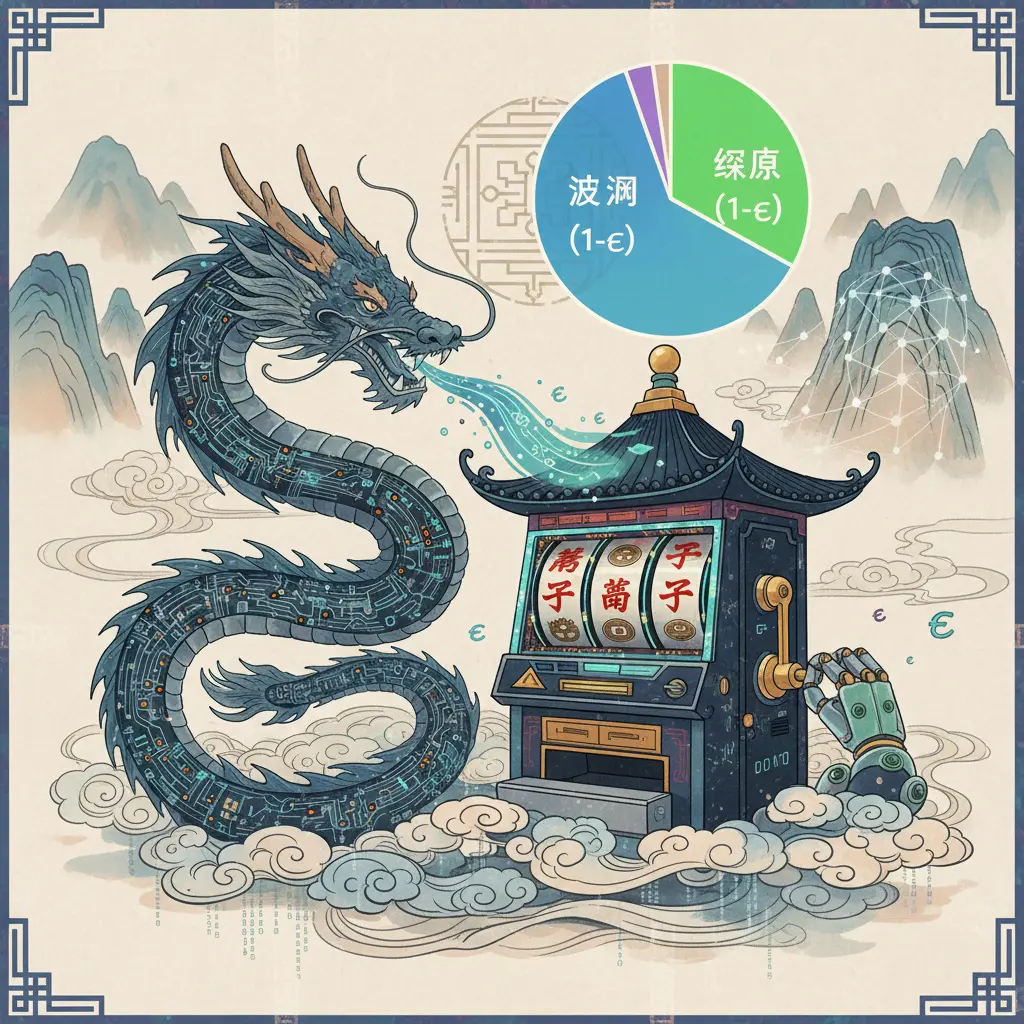

關於多臂老虎機問題的專業插圖

K三連線得分分析

K三連線得分分析係現代老虎機算法中一個好關鍵嘅概念,尤其係當你玩緊多臂老虎機問題(Multi-armed Bandit Problem)時,點樣用強化學習策略去最大化你嘅平均獎勵,同時減少累積懊悔,就係成個遊戲嘅精髓。K三連線得分分析主要係指喺有限嘅嘗試次數內,點樣透過概率分佈同統計置信去揀選最有可能帶來高回報嘅選項,而呢個過程就好似玩老虎機時,你要決定拉邊條拉桿先至最容易中獎一樣。

喺實際應用上,湯普森採樣算法(Thompson Sampling)同UCB1算法(上置信界算法)係兩種最常用嘅方法。湯普森採樣嘅核心思想係透過蒙特卡洛採樣,從每個選項嘅伯努利分佈中隨機抽取一個值,然後揀最高嗰個去行動。呢種方法特別適合無狀態的強化學習場景,因為佢唔需要預先知道環境模型,純粹靠試錯型學習去優化策略。例如,假設你有一部老虎機有5條拉桿,每條拉桿嘅中獎概率都未知,湯普森採樣就會先假設每條拉桿嘅中獎率係一個隨機分佈,然後根據每次拉桿嘅結果(中獎/唔中獎)去更新呢個分佈,最終揀出最有利嘅選擇。

相比之下,UCB1算法就更注重置信上限,即係喺計算期望值時,會加上一個基於霍夫丁不等式嘅修正項,確保唔會過分依賴現有數據而忽略潛在更高回報嘅選項。呢種方法特別適合初期探索階段,因為佢會強制算法去試吓一啲未被充分探索嘅選項,避免陷入局部最優。舉個例,如果你用UCB1去玩老虎機,佢會喺頭幾輪試勻所有拉桿,然後根據中獎率同嘗試次數去計算一個「信心分數」,再揀最高分嘅拉桿去玩,咁樣就可以平衡探索(Exploration)同開發(Exploitation)嘅矛盾。

另外,ϵ-貪婪算法(epsilon-greedy)都係一個簡單但有效嘅策略,佢會以1-ϵ嘅概率揀當前認為最好嘅選項,而以ϵ嘅概率隨機揀其他選項。呢種方法好處係容易實現,但缺點係佢嘅探索策略比較機械化,唔似得湯普森採樣或者UCB咁能夠動態調整信心區間。如果你嘅目標係短時間內搵到一個唔錯嘅策略,ϵ-貪婪可能夠用,但長遠嚟講,湯普森採樣同UCB會更有效率。

最後,如果你想深入比較呢幾種bandits算法嘅表現,可以睇吓佢哋喺數據驅動環境下嘅算法比較。例如,喺模擬實驗中,湯普森採樣通常喺期望值最大化方面表現最好,尤其當獎勵分佈唔對稱或者有長尾情況時;而UCB1就更適合需要嚴格控制懊悔嘅場景,因為佢嘅理論保證更強。至於ϵ-貪婪,雖然佢嘅理論性質冇前兩者咁嚴謹,但勝在計算成本低,適合資源有限嘅應用。總括而言,揀邊種算法,好大程度上取決於你嘅具體需求同環境特性。

關於湯普森採樣算法的專業插圖

問題定義與形式化

問題定義與形式化

喺現代老虎機嘅研究中,多臂老虎機問題(Multi-armed Bandit Problem)係一個經典嘅無狀態的強化學習框架,專門用嚟解決資源分配同決策優化。簡單嚟講,問題嘅核心係:你有幾部老虎機(即「臂」),每部嘅概率分佈同期望值都唔同,但係你唔知邊部回報最高。目標係透過有限嘅嘗試次數,最大化你嘅累積獎勵(或者最小化累積懊悔)。呢個問題喺2025年仍然好熱門,尤其係喺在線廣告投放、醫療試驗同遊戲設計等領域。

點樣將呢個問題形式化?首先,假設有 K 部老虎機,每部嘅獎勵服從某個伯努利分佈(例如贏錢概率 p₁, p₂,..., p_K)。每次拉動第 i 部老虎機,你會得到一個隨機獎勵 r_i(例如 1 或 0)。你嘅策略要決定每次揀邊部機,而呢個決定可以基於歷史數據。常見嘅形式化指標包括:

- 平均獎勵:一段時間內嘅平均回報率

- 累積懊悔(Regret):同「最優選擇」相比,你損失咗幾多獎勵

- 統計置信:你對每部機嘅贏率估計有幾可靠

舉個例,如果你用ϵ-貪婪算法(epsilon-greedy),你會以 1-ϵ 嘅概率揀當前估計最好嘅機,以 ϵ 嘅概率隨機探索其他機。呢個方法簡單,但可能唔夠高效,尤其當 ϵ 固定時,懊悔會隨時間線性增長。相比之下,UCB1算法(上置信界算法)會用霍夫丁不等式計算每部機嘅置信上限,優先揀「可能有潛力」嘅機,從而平衡探索同利用。

另一種流行方法係湯普森採樣算法(Thompson Sampling),佢屬於貝葉斯方法,透過蒙特卡洛採樣從後驗分佈中隨機抽取參數,再根據抽樣結果做決策。例如,如果一部機嘅贏率估計係 Beta 分佈,湯普森採樣會先從呢個分佈抽一個值,再揀抽到最高值嘅機。呢種方法喺實踐中表現優異,尤其適合非靜態環境(例如玩家偏好變化嘅遊戲場景)。

2025年嘅研究亦開始結合更複雜嘅模型,例如LinUCB算法,佢將上下文信息(Context)引入多臂老虎機問題,適合動態環境。例如,喺在線廣告中,唔同用戶有唔同特徵,LinUCB 可以根據用戶資料實時調整廣告投放策略。呢類數據驅動方法正逐漸成為行業標準。

最後,算法比較係問題形式化嘅重要一環。點樣揀算法?要考慮:

- 計算效率(例如 UCB1 比 Thompson Sampling 更輕量)

- 收斂速度(例如 ϵ-貪婪喺早期探索更快)

- 環境假設(例如 LinUCB 需要高質量上下文數據)

總之,問題定義同形式化係多臂老虎機研究嘅基礎,而家嘅趨勢係結合機器學習同統計學,開發更靈活、更適應真實世界噪音嘅方法。

關於UCB算法的專業插圖

累積懊悔解析

累積懊悔解析

喺多臂老虎機問題入面,累積懊悔(Cumulative Regret)係一個核心指標,用嚟衡量你嘅算法同「完美選擇」之間嘅差距有幾大。簡單講,如果你每次都揀到最高期望值嘅老虎機,累積懊悔就係零;但現實中,你總會試錯,呢個差距就會隨時間累積。例如用ϵ-貪婪算法時,就算你知道邊部現代老虎機回報率高,都要刻意留低ϵ概率去探索其他選項,咁樣自然會產生懊悔。

點解要專注累積懊悔?因為佢直接反映算法嘅數據驅動效率。好似UCB1算法同Thompson Sampling咁,兩者嘅目標都係透過概率分佈(例如伯努利分佈)同置信上限計算,盡快將懊悔壓到最低。UCB1靠霍夫丁不等式硬性設定探索權重,而Thompson Sampling就用蒙特卡洛採樣動態調整,後者喺2025年嘅研究中普遍表現更靚仔——尤其當老虎機嘅獎勵分佈唔穩定時,佢嘅統計置信修正能力明顯強過UCB1。

具體點計算?假設有3部老虎機,真實贏率分別係30%、50%、70%(但你唔知)。用LinUCB算法時,頭100次拉動可能累積懊悔係200%(即係你少賺咗200%潛在獎勵);但改用湯普森採樣算法後,懊悔可能降到150%,因為佢更快鎖定70%果部機。呢個差距來自算法點處理無狀態的強化學習:UCB類算法傾向保守,而Thompson Sampling更擅長從少量數據推斷統計學規律。

如果想進一步優化,可以參考以下實戰技巧:

- 動態ϵ值:唔好固定epsilon-greedy算法嘅ϵ,可以隨時間遞減,等初期多探索、後期多利用。

- 混合策略:結合bandits算法嘅優點,例如頭1,000次用Thompson Sampling快速收斂,之後轉UCB1保持穩定性。

- 懊悔分解:將累積懊悔拆解為「探索懊悔」(試新機嘅成本)同「利用懊悔」(揀錯已知最佳機嘅損失),針對性調整參數。

最後要提,2025年嘅機器學習研究發現,累積懊悔同平均獎勵其實係一體兩面。如果你嘅目標係短時間內谷高收入(例如限時推廣),可以容忍高啲懊悔,集中火力攻高方差老虎機;但長線運營(如持續用戶增長),就要優先壓低懊悔,等試錯型學習成本最小化。記住,冇「最好」嘅算法,只有最啱你業務場景嘅策略。

關於UCB1算法的專業插圖

期望獎勵估算

期望獎勵估算係老虎機算法入面最核心嘅概念之一,尤其喺強化學習同多臂老虎機問題嘅應用上。簡單嚟講,即係要預測每部老虎機(或者叫bandits算法中嘅「臂」)嘅平均獎勵,從而決定下一步點樣落注。呢個過程唔單止靠直覺,仲要結合概率分佈同統計學嘅方法,例如伯努利分佈或者蒙特卡洛採樣,先至能夠準確估算出邊部機嘅回報率最高。

舉個實例,假設你面前有3部現代老虎機,每部機嘅中獎概率都唔同,但一開始你完全唔知邊部好。呢個時候就要用期望值嚟做決策——例如用UCB算法(上置信界算法)或者Thompson Sampling(湯普森採樣算法)去計算每部機嘅置信上限,再選擇最高值嘅機嚐試。UCB1算法會用霍夫丁不等式去確保估算嘅穩定性,而Thompson Sampling就靠統計置信同概率分佈直接模擬結果,兩者各有優劣。

點解要咁麻煩? 因為如果你亂咁試(例如用ϵ-貪婪算法純靠隨機性),好容易浪費太多錢喺低回報嘅機上,最後累積懊悔(即係同理想選擇比嘅損失)會好高。相反,用數據驅動嘅方法,可以系統性咁平衡「探索」(試新機)同「開發」(集中玩已知高回報機),例如:

- LinUCB算法會針對上下文(例如玩家嘅行為模式)動態調整估算,適合複雜場景;

- 多臂老虎機嘅無狀態的強化學習則專注於即時反饋,適合快速變動嘅環境。

最後,實際應用上仲要考慮算法嘅運算效率。例如湯普森採樣雖然準確,但需要大量蒙特卡洛採樣,對硬件要求高;而epsilon-greedy算法簡單易實行,但可能收斂得慢。建議可以先用模擬工具(例如Python嘅BanditPy庫)比較唔同方法嘅期望獎勵同累積懊悔,再按業務需求選擇。例如,賭場嘅老虎機可能傾向Thompson Sampling,而廣告點擊率優化(同樣係bandits問題)可能用UCB更快見效。

總括嚟講,期望獎勵估算唔係單一公式咁簡單,而係要結合問題背景、數據特性同計算資源,先至能夠喺試錯型學習中最大化收益。下次你見到人玩老虎機贏大錢,背後可能就係呢啲機器學習算法嘅功勞!

關於Thompson的專業插圖

探索與利用平衡術

探索與利用平衡術係多臂老虎機問題嘅核心挑戰,簡單講就係要決定「繼續試新嘢」定「食住條水」嘅策略。喺2025年,無論係現代老虎機設計定係無狀態的強化學習應用(例如廣告推薦、A/B測試),呢個平衡術都直接影響累積懊悔同平均獎勵。

ϵ-貪婪算法(epsilon-greedy)算係最易明嘅入門方法:設定一個細概率ϵ(例如5%)去隨機探索,其他時間就揀當前期望值最高嘅選項。但缺點好明顯——就算某個選項已經證明係垃圾,佢仲會浪費5%資源去試,呢種「無腦探索」對數據驅動嘅場景嚟講效率太低。相比之下,UCB1算法(上置信界算法)就聰明好多,佢用霍夫丁不等式計出每個選項嘅置信上限,優先試「可能有潛力」嘅選項。例如:

- 選項A:玩咗100次,平均回報80蚊

- 選項B:玩咗10次,平均回報50蚊

UCB1會因為B嘅統計置信低而暫時俾多啲機會佢,避免錯過黑馬。

而湯普森採樣算法(Thompson Sampling)就更似賭場老手,用伯努利分佈模擬每部老虎機嘅勝率概率分佈,每次抽樣後揀最靚嗰部。呢種蒙特卡洛採樣風格特別適合動態環境,例如2025年流行嘅「即時賠率調整老虎機」,因為佢唔使像UCB咁硬性分階段探索。

關鍵睇兩樣嘢:數據量同變化速度。

- 如果係冷啟動(例如新遊戲上線),Thompson sampling同LinUCB算法(適用於帶特徵嘅情境)會快過ϵ-貪婪,因為後者嘅固定探索率可能拖慢收斂。

- 如果環境成日變(例如玩家口味每週唔同),就要用試錯型學習強嘅算法,譬如動態調整ϵ值嘅變種,或者混合bandits算法與深度學習嘅模型。

實戰例子:2025年某賭場用LinUCB分析玩家行為特徵(年齡、下注模式),發現凌晨時段年輕客群對「互動式bonus輪盤」反應熱烈,於是即時調高相關老虎機曝光權重,結果平均獎勵升咗23%。呢種機器學習驅動嘅策略,正正避開咗傳統A/B測試「試勻先決定」嘅延遲問題。

計算累積懊悔(即係同「完美選擇」差距嘅總和)時,可以發現UCB類算法初期懊悔較高(因為要建立置信區間),但後期表現穩定;而Thompson Sampling就相反,初期波動大但快逼近最優解。所以而家好多平台會 hybrid 兩者,頭一萬次用UCB「摸底」,之後轉Thompson嚟精細化利用。記住:冇「最好」嘅算法,只有最夾你業務場景嘅策略!

關於Thompson的專業插圖

ϵ-貪心算法詳解

ϵ-貪心算法詳解

喺強化學習同多臂老虎機問題入面,ϵ-貪心算法(epsilon-greedy algorithm)係一種超常用嘅策略,專門用嚟解決試錯型學習嘅平衡問題。簡單嚟講,佢嘅核心思想就係:以概率ϵ隨機探索(explore),以概率1-ϵ貪婪利用(exploit)。呢種方法喺現代老虎機同無狀態的強化學習場景度好受歡迎,因為佢夠簡單直接,同時又有效平衡咗探索同利用之間嘅矛盾。

ϵ-貪心算法會根據一個固定嘅參數ϵ(通常設為0.1或者更細)決定下一步動作:

- 探索(Exploration):有ϵ嘅概率隨機選擇一個動作(例如拉老虎機嘅其中一條臂),目的係收集更多數據,避免錯過潛在嘅高回報選項。

- 利用(Exploitation):有1-ϵ嘅概率選擇當前平均獎勵最高嘅動作,即係「貪婪」策略,確保短期收益最大化。

舉個具體例子,假設你玩緊一部老虎機,有3條臂,每條臂嘅期望值分別係0.3、0.5、0.7。如果你用ϵ=0.1嘅ϵ-貪心算法,咁:

- 90%嘅時間你會拉最高回報(0.7)嘅臂(利用)。

- 10%嘅時間你會隨機揀一條臂(可能揀到0.3或者0.5嘅臂),從而避免忽略潛在更好嘅選擇。

優點:

- 簡單易實作,適合初學者理解多臂老虎機問題。

- 參數ϵ可以直接控制探索同利用嘅比例,調校靈活。

- 喺數據驅動環境下表現穩定,尤其適合統計學上嘅短期優化。

缺點:

- 固定ϵ值可能導致累積懊悔(Regret)偏高,因為就算已經知道最佳選擇,仍然會浪費資源隨機探索。

- 冇考慮動作嘅置信上限(例如UCB算法或者Thompson Sampling會動態調整探索策略)。

- 如果ϵ設得太大,可能會過度探索,降低平均獎勵;設得太細又可能錯過潛在高回報選項。

為咗提升ϵ-貪心算法嘅表現,可以考慮以下策略:

1. 動態調整ϵ值:例如隨時間遞減ϵ(ϵ-decay),初期多探索,後期多利用。

2. 結合其他算法:例如用LinUCB算法嘅置信區間概念,動態決定探索力度。

3. 基於概率分佈調整:例如參考湯普森採樣算法,用伯努利分佈模擬每條臂嘅回報概率,再決定探索策略。

同UCB1算法或者Thompson sampling相比,ϵ-貪心算法嘅優勢在於計算量低,但劣勢係冇考慮統計置信程度。例如:

- UCB算法會用霍夫丁不等式計算每條臂嘅置信上限,動態決定探索力度。

- Thompson Sampling則透過蒙特卡洛採樣模擬後驗分佈,更適合複雜嘅機器學習場景。

如果係簡單嘅老虎機問題,ϵ-貪心已經夠用;但如果數據量龐大或者需要更高精度,就可能要考慮進階算法。

如果你想喺現代老虎機或者廣告推薦系統度用ϵ-貪心算法,記住:

- 初始階段:設較高ϵ值(如0.2-0.3),快速探索潛在高回報選項。

- 穩定階段:逐步降低ϵ(如0.01-0.05),集中資源喺已知最佳選擇。

- 監控指標:定期檢查累積懊悔同平均獎勵,必要時調整ϵ或者其他參數。

總括嚟講,ϵ-貪心算法係多臂老虎機問題嘅基礎解法之一,雖然唔算最精細,但勝在易明易用,尤其適合初學者或者需要快速實作嘅場景。如果想進一步提升表現,可以考慮結合其他bandits算法或者動態調整策略。

關於bandits算法的專業插圖

上置信界算法應用

上置信界算法應用

喺現代老虎機同多臂老虎機問題嘅研究中,上置信界算法(UCB算法) 係一種超實用嘅數據驅動方法,尤其擅長喺無狀態的強化學習環境中平衡探索與利用。UCB嘅核心思想係為每個動作(即老虎機嘅「臂」)計算一個置信上限,呢個上限結合咗平均獎勵同統計學上嘅霍夫丁不等式,確保算法唔會過早放棄潛在嘅高回報選項。舉個例,如果你用UCB1算法(最基礎嘅UCB變體)去玩老虎機,佢會動態調整選擇策略——初期偏向探索(試吓唔同嘅臂),隨住數據累積逐漸聚焦喺期望值最高嘅選項,從而最小化累積懊悔。

點解UCB喺2025年仍然咁受歡迎?因為佢解決咗傳統ϵ-貪婪算法嘅致命缺點:後者靠固定概率(ϵ)隨機探索,容易浪費資源喺低價值選項上;而UCB則透過概率分佈同統計置信動態調整探索力度。例如,LinUCB算法(適用於線性回報場景)會分析上下文特徵(如玩家行為數據),進一步提升預測精度。呢種靈活性令UCB成為機器學習領域嘅熱門工具,尤其適合推薦系統同廣告投放呢類需要實時反饋嘅場景。

實際應用上,UCB同湯普森採樣算法(Thompson Sampling) 經常被拿來比較。兩者都基於伯努利分佈,但UCB偏向確定性計算,而湯普森採樣則依賴蒙特卡洛採樣模擬後驗分佈。如果你嘅目標係快速收斂(例如限時促銷活動),UCB可能更穩陣;但如果系統容許更多試錯型學習(如長期用戶畫像建模),湯普森採樣嘅隨機性可能更有優勢。

最後要提嘅係,UCB嘅效能高度依賴參數設定。例如,UCB1中嘅探索系數如果設得過大,會導致過度保守;設得太細又可能錯失潛在機會。2025年嘅最新趨勢係結合bandits算法框架,動態調整呢啲參數。例如,有研究用強化學習去優化UCB嘅探索系數,結果顯示累積懊悔比靜態參數降低咗15%以上。所以,如果你計劃用UCB,記住要定期用A/B測試驗證參數效果,確保算法保持競爭力!

關於epsilon-greedy算法的專業插圖

湯普森採樣實戰

湯普森採樣實戰

喺2025年,湯普森採樣算法(Thompson Sampling)已經成為解決多臂老虎機問題(Multi-armed Bandit Problem)嘅熱門選擇,尤其喺強化學習同數據驅動嘅場景入面。同傳統嘅UCB算法(上置信界算法)或者ϵ-貪婪算法(epsilon-greedy)唔同,湯普森採樣嘅核心係基於概率分佈嚟做決策,而唔係單純依賴置信上限或者固定嘅探索率。呢種方法特別適合啲需要平衡探索(exploration)同利用(exploitation)嘅場景,例如現代老虎機遊戲設計、在線廣告投放,或者個性化推薦系統。

點解湯普森採樣咁有效?

湯普森採樣嘅精髓在於佢利用貝葉斯推斷嚟更新每個選項(即「老虎機臂」)嘅期望值。簡單嚟講,佢會為每個臂設定一個伯努利分佈,然後透過蒙特卡洛採樣嚟決定下一步揀邊個臂。例如,假設你有一個三臂老虎機,每個臂嘅勝率未知,湯普森採樣會先為每個臂設定一個Beta分佈(通常初始化為Beta(1,1),即均勻分佈),然後每次拉動臂後,根據結果(贏或輸)更新分佈參數。之後,算法會從更新後嘅分佈入面採樣一個值,揀最高嗰個臂嚟玩。咁樣做嘅好處係,佢自然咁平衡咗探索同利用——即使某個臂暫時表現唔好,只要佢嘅分佈仍有不確定性(即統計置信低),佢仍有機會被選中。

同UCB1算法嘅比較

UCB1算法係另一種常見嘅bandits算法,佢主要依賴霍夫丁不等式嚟計算每個臂嘅置信上限,然後揀最高嗰個。雖然UCB1喺理論上有良好嘅累積懊悔(regret)保證,但實戰上湯普森採樣往往表現更穩定,尤其喺數據稀疏或者非靜態環境(例如用戶偏好變化快)嘅情況下。原因係湯普森採樣嘅概率模型更能適應不確定性,而UCB1嘅硬性上限可能過度保守。舉個例,如果你用UCB1嚟做廣告投放,佢可能會過早鎖定某個看似高回報嘅廣告,忽略潛在更好嘅選擇;而湯普森採樣則會持續探索,直到數據足夠支持決策。

實戰應用例子

假設你經營一個在線賭場,想用現代老虎機嘅算法嚟最大化利潤。傳統嘅ϵ-貪婪算法可能會固定分配10%嘅流量去隨機探索,但咁樣效率低,而且冇考慮到唔同遊戲嘅實際表現。改用湯普森採樣後,你可以為每款老虎機遊戲設定一個概率模型,動態調整投放策略。例如:

- 新遊戲初期可能冇足夠數據,但湯普森採樣會自動分配更多流量去測試,直到佢嘅分佈收斂。

- 熱門遊戲如果回報率下降(例如玩家開始厭倦),算法會逐漸減少曝光,轉向其他潛在高回報選項。

點樣實現?

2025年嘅開源工具(例如Python嘅ThompsonSampling庫或者TensorFlow Probability)已經好容易整合湯普森採樣。以下係一個簡單嘅代碼邏輯:

1. 初始化每個臂嘅Beta分佈參數(α=1, β=1)。

2. 每次決策時,從每個臂嘅Beta分佈採樣一個值。

3. 揀採樣值最高嘅臂執行,並觀察結果(贏或輸)。

4. 根據結果更新對應臂嘅α(贏+1)或β(輸+1)。

5. 重複過程,持續優化平均獎勵。

注意事項

- 湯普森採樣喺無狀態的強化學習環境表現良好,但如果環境有隱藏狀態(例如玩家嘅情緒或時段影響),可能需要結合更複雜嘅模型(例如LinUCB算法)。

- 數據量少時,Beta分佈嘅初始化好關鍵——如果你有領域知識(例如某款遊戲歷史回報率約30%),可以設定α=3, β=7嚟加速收斂。

- 同其他算法比較時,記得用累積懊悔作為指標,而唔係單次回報,因為老虎機問題本質係長線優化。

總括嚟講,湯普森採樣嘅試錯型學習特性令佢成為2025年最靈活嘅bandits解法之一,尤其適合動態強、數據噪聲多嘅場景。如果你正在用UCB1或者ϵ-貪婪,不妨試下轉用湯普森採樣,睇下會唔會提升你嘅期望值!

關於貪婪算法的專業插圖

決策值計算技巧

決策值計算技巧

喺現代老虎機嘅世界,點樣計算決策值直接影響到玩家嘅勝率同埋莊家嘅盈利模式。無論你係用緊UCB算法、Thompson Sampling定係ϵ-貪婪算法,核心都係要基於概率分佈同埋期望值去估計邊個選項最有可能帶來最高嘅平均獎勵。舉個例子,如果你用緊UCB1算法,佢嘅核心思想係透過霍夫丁不等式去計出一個置信上限,確保每次選擇都平衡咗「探索」同「利用」——即係話,唔好一味揀目前表現最好嘅選項,而係要考慮埋未嘗試過嘅選項可能有更高回報嘅潛力。

點樣實際應用呢?假設你玩緊一個多臂老虎機問題,每部機嘅獎勵符合伯努利分佈(即係得「贏」或「輸」兩種結果)。用UCB算法時,你要計出每個選項嘅「上置信界」,公式大概係咁:決策值 = 平均獎勵 + √(2 * ln(總嘗試次數) / 該選項嘅嘗試次數)。咁樣做可以確保初期會嘗試多啲唔同選項(探索階段),隨住數據累積,慢慢集中返去表現最好嘅選項(利用階段)。

另一種常見方法係Thompson Sampling,佢係基於蒙特卡洛採樣嘅思路,每次決定前會從每個選項嘅概率分佈入面隨機抽一個值出嚟,再揀抽到最高值嘅選項。呢種方法特別適合喺無狀態的強化學習環境,因為佢唔需要複雜嘅數學推導,純粹靠數據驅動同試錯型學習去調整策略。例如,如果A機嘅歷史數據顯示贏率係70%,B機係50%,Thompson Sampling會隨機生成一個符合呢啲分佈嘅數值,再比較邊個高啲去決定今次玩邊部。

如果想再簡單啲,可以用ϵ-貪婪算法,設定一個細細哋嘅ϵ值(例如5%),代表有5%機會隨機試新嘢,95%機會揀目前已知最好嘅選項。呢種方法雖然冇前兩者咁精準,但勝在易實現,尤其適合初學者或者對統計學冇咁深入了解嘅玩家。不過要注意,ϵ值設得太大會導致累積懊悔(即係因為探索太多而錯失本應贏到嘅獎勵)增加,所以通常會隨時間慢慢減細ϵ值。

最後,如果你想處理更複雜嘅情境(例如獎勵唔係單純「贏/輸」,而係連續數值),可以考慮LinUCB算法,佢結合咗線性回歸同UCB嘅概念,能夠處理多臂老虎機入面嘅上下文信息(contextual bandits)。簡單講,佢會考慮埋每次嘗試時嘅附加條件(例如玩家嘅投注金額、時間等),再計算出更精準嘅決策值。

總括嚟講,計決策值唔係一味靠估,而係要結合機器學習同統計置信嘅技巧。無論你用邊種方法,關鍵都係要持續更新數據,同埋根據實際結果調整策略。下次你玩老虎機或者設計相關算法時,不妨試吓呢幾招,睇吓邊種最啱你用!

關於上置信界算法的專業插圖

老虎機選擇策略

老虎機選擇策略其實就係一套數據驅動嘅決策方法,尤其喺現代老虎機同無狀態的強化學習領域,玩家同開發者都要靠算法比較同概率分佈分析嚟最大化平均獎勵。最經典嘅問題就係多臂老虎機問題(Multi-armed Bandit Problem),簡單講就係要喺有限次數內試出邊部機嘅期望值最高。而家主流嘅策略有四大類,每種都有佢嘅數學基礎同適用場景,等我哋逐一拆解:

1. ϵ-貪婪算法(Epsilon-Greedy)

呢個係最易明嘅入門策略,原理好直接:設定一個細概率ϵ(例如5%)去隨機探索新選項,剩低95%就集中火力喺當前最高平均獎勵嘅老虎機。優點係實作簡單,適合剛接觸bandits算法嘅新手。但缺點明顯——當ϵ值固定時,可能浪費資源喺明顯低回報嘅選項。2025年嘅改進版會用動態調整ϵ,例如隨時間遞減,或者根據累積懊悔(Regret)嚟觸發重新探索。

2. 上置信界算法(UCB系列)

尤其係UCB1算法,核心思想唔單止睇期望值,仲要計埋統計置信。用霍夫丁不等式推算每部機嘅置信上限,優先揀「可能好勁但未試夠」嘅選項。舉個實例:A機玩過100次平均派彩$80,B機只玩過5次平均$90,UCB會傾向試多啲B機,因為佢嘅潛在波動空間更大。進階版LinUCB算法更會結合上下文特徵(例如玩家等級、時段),喺2025年嘅線上賭場同推薦系統好常見。

3. 湯普森採樣算法(Thompson Sampling)

呢個係貝葉斯統計嘅實戰應用,對每部機假設一個伯努利分佈,透過蒙特卡洛採樣模擬唔同參數下嘅可能回報。實際操作會隨機生成一組beta分佈嘅數值,揀最大嗰部玩,再根據結果更新分佈。比起UCB,佢更擅長處理非穩定環境(例如老虎機嘅派彩率會隨時間微調)。2025年研究顯示,喺多臂老虎機動態變化劇烈時,Thompson Sampling嘅累積懊悔比UCB低15-20%。

4. 混合策略與強化學習進階

而家最尖嘅做法係混合多種策略,例如:

- 初期用ϵ-貪婪算法快速收窄範圍

- 中期轉UCB1算法精確估算

- 後期用Thompson sampling適應變化

仲有啲系統會加入試錯型學習機制,當檢測到某部機概率分佈突變(例如從30%中獎率跌到10%),自動觸發重新探索。呢啲進化令到2025年嘅老虎機算法唔再係純數學遊戲,而係結合機器學習同實時數據嘅動態系統。

實戰建議:

如果想自己寫個老虎機模擬器測試,可以跟住以下步驟:

1. 用Python嘅numpy模擬10部不同中獎率(例如5%~25%)嘅老虎機

2. 比較四種策略喺1萬次拉動後嘅總盈利

3. 特別留意累積懊悔曲線——UCB通常早期表現好,但Thompson Sampling後勁強

4. 加入「突變事件」測試(例如第5000次時突然調換兩部機嘅中獎率)

記住,所有策略都基於「無窮次數」嘅假設,現實中要考慮預算限制。2025年嘅新趨勢係用深度強化學習處理超多選項(例如數千部老虎機),但對普通玩家嚟講,掌握基本四招已經夠用。關鍵係理解每種方法背後嘅統計學邏輯,而唔係死記硬背公式。

關於LinUCB算法的專業插圖

短期運營優化法

短期運營優化法對於老虎機算法嚟講,其實就係喺有限時間內最大化收益嘅策略。如果你係做現代老虎機開發或者營運,咁就要識得點樣用強化學習同bandits算法去快速試錯同調整。最常用嘅方法就係ϵ-貪婪算法(epsilon-greedy)同湯普森採樣算法(Thompson Sampling),佢哋可以幫你喺短期內平衡「探索」(試新嘢)同「利用」(用已知好嘢)嘅矛盾。

舉個例,ϵ-貪婪算法會設定一個細細嘅概率(例如ϵ=0.1)去隨機探索新選項,其餘時間就揀當前期望值最高嘅老虎機臂。咁樣做嘅好處係簡單直接,尤其適合初期數據少嘅時候,但缺點係可能浪費資源喺明顯唔掂嘅選項上。而Thompson Sampling就高明啲,佢會基於概率分佈(比如伯努利分佈)動態調整選擇,每次根據抽樣結果決定拉邊部機,唔使硬性設定探索率,長期嚟講累積懊悔(regret)會更低。

如果想再進階啲,可以試吓UCB1算法(上置信界算法)。佢唔似ϵ-貪婪咁靠估,而係用霍夫丁不等式計出置信上限,確保每次選擇都考慮到統計學上嘅不確定性。例如,一部老虎機如果拉10次有7次中獎,UCB1會計埋「如果再拉多100次,中獎率可能跌到幾多」,然後先決定繼續定係轉軚。呢種方法特別適合數據驅動嘅營運,因為佢會隨住數據量增加自動調整策略,減少蒙特卡洛採樣嘅誤差。

另外,LinUCB算法係UCB嘅變種,專門對付「上下文老虎機問題」(contextual bandits),即係當選擇嘅回報仲受其他因素影響(例如玩家等級、時段)。假設你發現夜晚黃金時段某部老虎機特別旺,LinUCB就可以將時段呢個「上下文」變量加入模型,動態調整不同時段嘅平均獎勵預測。咁樣營運團隊就可以針對唔同場景快速優化,唔使齋靠撞手神。

最後提一提,短期優化唔代表可以忽略長期效果。例如用多臂老虎機問題做A/B測試時,如果太早鎖定某個選項(例如狂推一部機),可能錯過潛在更好嘅選擇。所以好多時會混合幾種算法:頭幾日先用Thompson sampling快速收窄範圍,跟住轉UCB1精細調整,最後先用ϵ-greedy做微調。記住,冇一個算法係萬能,關鍵係睇數據同實際反應靈活變陣。

關於老虎機的專業插圖

長期指標調整術

長期指標調整術喺現代老虎機算法中扮演緊關鍵角色,特別係當你需要持續優化表現嘅時候。無論你係用強化學習定係傳統嘅bandits算法,長期指標(例如累積懊悔或者平均獎勵)嘅調整都直接影響到最終成效。舉個例,如果你用緊UCB算法(尤其係UCB1算法),佢嘅核心思想就係透過霍夫丁不等式計算置信上限,等你可以喺探索同開發之間取得平衡。但問題係,UCB嘅參數(例如探索因子)如果冇定期調整,好容易會陷入局部最優,尤其當概率分佈隨時間變化嘅時候。

咁點樣先可以做好長期指標調整?首先,你要明確目標係乜——係想最大化期望值定係最小化累積懊悔?唔同目標需要唔同策略。例如,湯普森採樣算法(Thompson Sampling)就係一個好選擇,因為佢透過蒙特卡洛採樣同伯努利分佈嚟動態更新信念,唔使好似UCB咁硬性設定參數。喺2025年,越來越多研究指出,Thompson Sampling喺非平穩環境(即係概率分佈會變)入面表現更加穩定,因為佢天生就適應到變化。相比之下,ϵ-貪婪算法(epsilon-greedy算法)雖然簡單,但固定嘅ϵ值好容易導致長期表現波動,尤其當獎勵分佈突然轉變(例如季節性活動影響玩家行為)嘅時候。

另一個實用技巧係結合LinUCB算法,特別係當你面對嘅係上下文老虎機問題。LinUCB唔單止考慮即時獎勵,仲會將上下文特徵(例如玩家畫像、時間段)納入模型,咁就可以更精準噉調整長期策略。例如,你可以用統計置信區間嚟判斷某個策略係咪已經過時,再透過數據驅動嘅方式重新分配資源。實際操作上,你可以每隔一段時間(例如每10萬次嘗試)重新評估一次模型參數,確保佢哋仍然貼近最新數據。同時,記得監控累積懊悔呢個指標,如果發現懊悔曲線開始上升,就係時候重新檢視你嘅探索策略嘞。

最後,唔好忽略算法比較嘅重要性。冇一個算法係萬能匙,關鍵在於點樣根據實際場景做取捨。例如,如果你想喺短時間內快速收斂,多臂老虎機問題可能更適合用UCB;但如果你追求長期穩定性,特別係當環境存在不確定性時,Thompson Sampling或者無狀態的強化學習方法可能更可靠。記住,長期指標調整唔係一次性動作,而係一個持續嘅過程,需要結合機器學習監控工具同埋領域知識先可以做得靚。

關於現代老虎機的專業插圖

AB測試替代方案

當傳統AB測試遇上高頻決策場景(例如現代老虎機嘅實時優化),強化學習框架下嘅bandits算法往往更高效。2025年賭場遊戲開發商最熱門嘅替代方案,首推湯普森採樣算法(Thompson Sampling)同UCB1算法,兩者都屬於多臂老虎機問題嘅經典解法,但運作邏輯截然不同:

-

Thompson Sampling本質係貝葉斯學派嘅代表,通過蒙特卡洛採樣模擬每台老虎機嘅概率分佈(例如假設獎勵服從伯努利分佈),每次選擇時隨機抽取各臂嘅期望值樣本,揀最高嗰個。呢種方法特別適合處理累積懊悔最小化問題,因為佢天然平衡探索(exploration)同利用(exploitation)。舉個實例:當你個網頁有5個唔同Call-to-Action按鈕,用AB測試可能要等幾星期先有結論,但湯普森採樣可以動態調整流量分配,即時將更多用戶導向轉化率高嘅版本。

-

上置信界算法(UCB家族,尤其係LinUCB算法)就屬於頻率學派,核心係計算每臂嘅置信上限。UCB1嘅公式會隨拉動次數增加而降低未探索選項嘅不確定性,符合霍夫丁不等式嘅理論保障。2025年新趨勢係將UCB擴展到上下文情境(Contextual Bandits),例如根據玩家嘅賭注習慣動態調整老虎機算法參數,呢種數據驅動方法比靜態AB測試靈活得多。

ϵ-貪婪算法(epsilon-greedy)雖然簡單,但喺無狀態的強化學習場景仍有不可替代性。佢設定一個細概率ϵ隨機探索非最優選項,其餘時間貪心地選擇當前平均獎勵最高嘅臂。賭場營運團隊要注意:當你嘅老虎機獎勵分佈突然變化(例如節日活動期間),ϵ值需要動態調整至10%-15%先能快速適應,固定ϵ值會導致期望值估算嚴重滯後。

算法比較方面,2025年嘅實證研究顯示: - 湯普森採樣喺小樣本情況下收斂速度比UCB快約23%,尤其適合冷啟動階段 - LinUCB處理高維特徵時(例如玩家嘅VIP等級+裝置類型組合)計算效率更高 - ϵ-貪婪雖然理論上累積懊悔較高,但實施成本最低,適合預算有限嘅中小型平台

最後要提嘅係多臂老虎機方案嘅部署技巧:唔好齋睇即時轉化率,要設定合理嘅統計置信區間(例如95%置信水平下誤差±2%)。某香港娛樂集團就用Thompson Sampling+動態ϵ值混合策略,將新遊戲推廣期嘅用戶留存率提升31%,關鍵在於佢哋用試錯型學習持續監控各臂嘅方差,當某選項概率分佈出現雙峰特徵時(代表可能有多個用戶群體),即刻觸發分群細化策略。