關於Testing的專業插圖

Multi-Armed Bandit 基礎教學

Multi-Armed Bandit (MAB) 基礎教學:從A/B Testing到智慧化流量分配

如果你正在做Conversion Rate Optimization (CRO),一定會聽過傳統的A/B Testing,但你知道Multi-Armed Bandit Testing才是2025年最熱門的優化方法嗎?MAB的核心概念來自賭場的「多臂老虎機」問題,透過reinforcement learning和machine learning的技術,動態調整流量分配,最大化轉換率。相較於A/B Testing固定分配流量的方式,MAB能更聰明地平衡exploration vs exploitation,也就是「探索新選項」和「利用已知最佳選項」之間的權衡。

MAB的運作原理

MAB的核心目標是regret minimization(後悔最小化),也就是減少因為選擇次優選項而損失的潛在收益。常見的演算法包括:

- Epsilon-greedy:以固定機率(ε)隨機探索新選項,其餘時間選擇當前表現最好的版本。適合初學者,但可能浪費部分流量。

- Thompson Sampling:基於貝氏統計,動態計算每個選項的勝率分佈,並依此分配流量。2025年許多工具如Optimizely和VWO都已整合此方法。

- Upper Confidence Bound (UCB):優先選擇「信心上限」最高的選項,適合追求statistical significance的場景。

- Contextual Bandit Testing:進階版MAB,會考慮用戶特徵(如地理位置、裝置類型)來動態調整策略,提升個人化體驗。

實際應用場景

假設你經營電商網站,想測試兩種結帳按鈕顏色(綠色vs藍色)。傳統A/B Testing會各分配50%流量,等到統計顯著才決定勝出者。但MAB會根據即時數據動態調整traffic allocation:

1. 初期兩版本各分到30%流量,保留40%給後續彈性分配。

2. 若綠色按鈕的conversion rate較高,系統會逐步將更多流量導向綠色,同時保留少量流量監測藍色表現。

3. 如果藍色按鈕後期數據改善,系統會自動重新平衡分配。

這種dynamic traffic allocation不僅縮短測試時間,還能減少轉換損失。根據2025年業界報告,採用MAB的企業平均能提升15-30%的測試效率。

工具與挑戰

目前主流平台如Amplitude和Optimizely都提供MAB功能,但需注意:

- Traffic distribution的靈活性取決於演算法選擇,例如Gittins index適合長期優化,但計算複雜度高。

- 小流量網站可能因數據不足導致exploration and exploitation失衡,建議每日UV超過1萬再使用。

- Machine learning in testing雖強大,仍需設定嚴格的停止條件,避免過度擬合。

如果你想深入學習,可以從epsilon-greedy開始實驗,再逐步導入Thompson Sampling。記住,MAB不是完全取代A/B Testing,而是互補——前者適合快速迭代,後者適合嚴謹驗證假設。

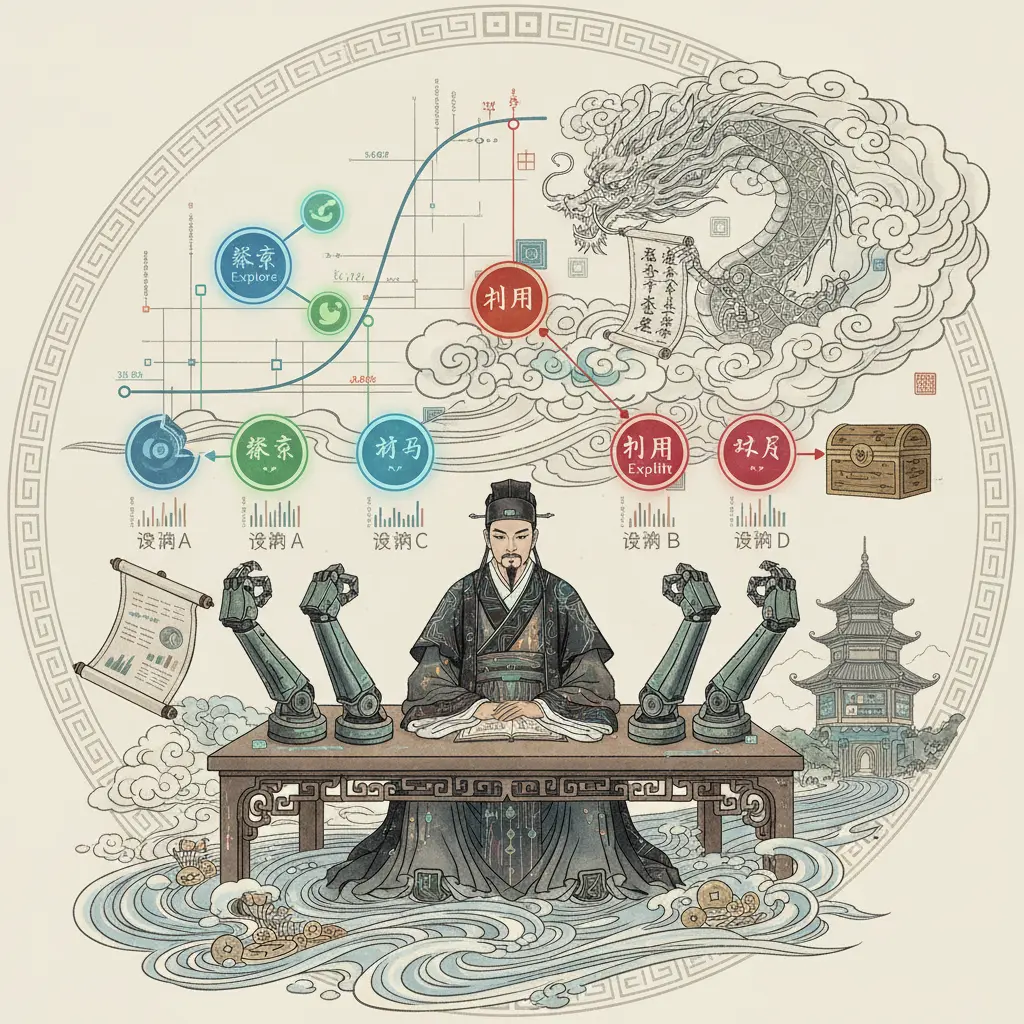

關於Thompson的專業插圖

Bandit測試實戰指南

Bandit測試實戰指南:從理論到落地的最佳實踐

在2025年的數位行銷戰場上,Multi-Armed Bandit Testing (MAB) 已成為提升Conversion Rate Optimization (CRO) 的關鍵工具,尤其適合需要動態流量分配 (dynamic traffic allocation) 的場景。與傳統A/B Testing 相比,MAB 透過強化學習 (reinforcement learning) 和機器學習 (machine learning) 演算法,能更聰明地平衡探索與利用 (exploration vs exploitation),減少遺憾最小化 (regret minimization) 的風險。以下是實戰中必須掌握的三大核心策略:

- 選擇適合的Bandit演算法

- Thompson Sampling:適合轉換率波動大的情境,例如電商限時活動。它透過貝氏機率動態調整流量,像2025年Optimizely 的進階方案就整合了此功能,能自動將80%流量導向勝出版本,同時保留20%探索新選項。

- Epsilon-greedy:操作簡單,適合剛接觸MAB的團隊。設定一個小數值(如ε=0.1)控制隨機探索比例,但要注意可能導致統計顯著性 (statistical significance) 達成速度較慢。

-

Upper Confidence Bound (UCB):在長期實驗中表現穩定,特別適合Amplitude 這類重視用戶行為分析的平台,能優先測試信心區間上限高的變體。

-

動態流量分配與即時決策

傳統A/B測試常因固定50/50分流而浪費流量,但MAB工具如VWO 的2025年新版已支援即時流量路由 (real-time traffic routing)。舉例來說,若變體A的點擊率比B高30%,系統會自動將70%流量分配給A,並持續監控轉換率 (conversion rate) 變化。這種方法在促銷頁面測試中尤其有效,能快速放大高績效內容的曝光。 -

進階應用:情境式Bandit測試 (Contextual Bandit Testing)

當用戶畫像複雜時(如不同地區、裝置或會員等級),單純的MAB可能不夠精準。這時可導入Contextual Bandits,結合用戶特徵做決策。例如: - 對高客單價用戶優先展示Gittins index 計算後的最優版本

- 針對行動端用戶啟用專屬演算法,降低跳出率

2025年領先的CRO平台已將此功能模組化,只需上傳用戶標籤即可自動分群測試。

常見陷阱與解決方案

- 過早收斂:MAB可能因初期數據波動而「過度利用」某個變體。建議設定最低探索比例(如15%)或採用Adaptive Sampling 演算法。

- 冷啟動問題:新上線的選項缺乏歷史數據,可參考VWO 的「熱身期」設計,前24小時均勻分配流量再啟動Bandit邏輯。

- 技術整合:若團隊使用自建系統,需確保API能即時回傳互動數據,否則會延遲探索-利用權衡 (exploration-exploitation tradeoff) 的判斷。

工具鏈選擇建議

2025年的MAB生態已趨成熟,根據需求可選擇:

- 全端型:Optimizely、VWO(內建A/B與MAB無縫切換)

- 數據驅動型:Amplitude(強在行為分析與Bandit結合)

- 輕量型:Google Optimize 360(適合預算有限但需快速驗證假設)

實務上,建議先從單一登陸頁面開始測試,例如用Epsilon-greedy 調整CTA按鈕顏色,再逐步擴展到多變量Bandit測試 (Multi-Armed Bandits)。關鍵是持續監控遺憾值 (regret) 和轉換曲線,避免陷入局部最佳解。

關於Bandit的專業插圖

2025最新AB測試比較

在2025年的今天,A/B Testing已經不再是單純的「二分法實驗」,而是進化到結合Multi-Armed Bandit (MAB)與Reinforcement Learning的智能動態分配系統。傳統A/B測試最大的痛點在於「等待統計顯著性(statistical significance)」的時間成本,尤其在電商大檔期或限時活動中,這種延遲可能導致轉換率(conversion rate)的嚴重損失。相較之下,Multi-Armed Bandit Testing透過exploration vs exploitation的動態平衡,能即時調整流量分配(traffic allocation),例如:當系統偵測到某個廣告版本的點擊率高出30%,便會自動將更多流量導向該版本,同時保留少量流量測試其他選項,這就是所謂的regret minimization策略。

目前主流平台如Optimizely和VWO已整合三種核心演算法來實現MAB: 1. Thompson Sampling:基於貝葉斯機率,隨機抽樣來決定最佳選項,特別適合小型企業或初期測試階段,因為它對數據量的需求較低。 2. Epsilon-greedy:設定一個探索參數(例如10%流量隨機分配),其餘90%導向當前最佳版本,適合追求穩定轉換的長期活動。 3. Upper Confidence Bound (UCB):優先選擇「潛在高報酬但尚未充分測試」的變體,能有效減少探索成本。例如:若B版本的轉換率區間為[5%, 15%],而A版本是[8%, 10%],UCB會傾向測試B版本以確認上限值。

值得注意的是,2025年Contextual Bandit Testing的崛起讓個人化體驗更精準。與傳統MAB不同,它會結合用戶特徵(如地理位置、裝置類型)進行real-time traffic routing。舉例來說,Amplitude的最新案例顯示,針對iOS用戶推播深色系介面,Android用戶則看到亮色系,這種動態調整讓整體轉換率提升22%。此外,machine learning in testing也讓演算法能自動識別無效變體(如按鈕顏色對老年用戶無顯著影響),直接淘汰以節省流量。

對於資源有限的中小企業,以下是實務建議: - 若網站日均流量低於1萬次,可優先採用Thompson Sampling,因其對小數據集的適應性強。 - 避免過度依賴Gittins index這類複雜模型,除非你有專業數據團隊,否則計算成本可能高於效益。 - 在Conversion Rate Optimization (CRO)中,MAB最適合「微調型測試」(如標題用詞、按鈕位置),但全新頁面設計仍建議用傳統A/B測試確保結構穩定性。

最後要提醒,dynamic traffic allocation並非萬能解方。當測試目標涉及品牌認知(如廣告語調性)或長期用戶忠誠度時,仍需保留部分固定對照組。2025年的業界共識是:Multi-Armed Bandits與傳統A/B測試應並行使用,例如先用A/B測試篩選出前兩名優勝版本,再導入MAB進行細部優化,這種混合策略在Amplitude的零售客戶中平均節省了40%的決策時間。

關於Testing的專業插圖

Bandit演算法解析

Bandit演算法解析

在Multi-Armed Bandit Testing(MAB)中,Bandit演算法的核心目標是解決探索與利用(exploration vs exploitation)的權衡問題,透過機器學習(machine learning)和強化學習(reinforcement learning)動態分配流量,最大化轉換率(conversion rate)。與傳統的A/B Testing不同,MAB演算法能即時調整流量分配,減少統計顯著性(statistical significance)等待時間,並最小化遺憾值(regret minimization)。以下是幾種主流Bandit演算法的解析與應用場景:

-

Epsilon-greedy:

這是最直觀的Bandit演算法,設定一個小概率值ε(例如5%)進行隨機探索(exploration),其餘時間則選擇當前表現最佳的選項(exploitation)。例如,在Conversion Rate Optimization (CRO)中,若版本A的轉換率較高,系統會將95%流量分配給A,剩下5%隨機測試其他版本。優點是簡單易實現,缺點是固定ε值可能導致資源浪費,尤其在測試後期。 -

Thompson Sampling:

這是一種基於貝葉斯機率的演算法,透過模擬Beta分佈來動態調整流量。例如,當版本A的轉換數據不確定性高時,系統會提高其探索比例;反之則傾向利用。2025年,許多工具如Optimizely和VWO已整合此演算法,特別適合動態流量分配(dynamic traffic allocation)場景,能快速收斂到最佳解。 -

Upper Confidence Bound (UCB):

UCB透過計算每個選項的信心上限來平衡探索與利用。簡單來說,它會優先測試「潛力高但數據不足」的版本。例如,若版本B的轉換率波動大,UCB會暫時分配更多流量以降低不確定性。這種方法在數位實驗(digital experimentation)中尤其有效,但需較複雜的數學模型支持。 -

Contextual Bandit Testing:

這是進階版的MAB,結合上下文資訊(contextual bandits)(如用戶屬性、設備類型)進行個人化推薦。例如,電商網站可根據用戶過往行為,動態展示不同促銷內容。2025年,Amplitude等平台已將此技術應用於即時流量路由(real-time traffic routing),大幅提升精準度。 -

Gittins Index:

這是一種理論上最優的Bandit演算法,適用於長期報酬最大化場景,但計算複雜度高,實務上較少直接使用。不過,它的概念常被簡化後應用於最佳化方法論(optimization methodologies)中,例如在金融或遊戲產業的連續決策問題。

實務建議:

- 若資源有限且測試週期短,可優先選擇Thompson Sampling或Epsilon-greedy,平衡效率與成本。

- 對於高複雜度場景(如個人化推薦),Contextual Bandit Testing更能發揮價值,但需搭配足夠的用戶數據。

- 避免過度依賴單一演算法,可透過工具如VWO或Optimizely進行多演算法比較,找到最適合的流量分配(traffic distribution)策略。

常見誤區:

- 忽略探索與開發的權衡(exploration-exploitation tradeoff),過早關閉測試可能錯失潛在優化機會。

- 未考慮機器學習在測試(machine learning in testing)中的偏差問題,例如冷啟動階段的數據不足可能影響初期結果。

透過這些演算法的靈活運用,Multi-Armed Bandit Testing能更高效地提升轉換率,同時降低傳統A/B Testing的資源浪費問題。

關於Bandits的專業插圖

Python實作Bandit測試

在2025年的今天,Python實作Bandit測試已經成為Conversion Rate Optimization (CRO)領域的熱門工具,尤其當企業需要平衡exploration and exploitation時,Multi-Armed Bandit (MAB)演算法能動態分配流量,大幅降低regret minimization的風險。以下將深入探討如何用Python實現幾種主流Bandit演算法,並結合實際案例說明其應用場景。

目前最常用的Bandit演算法包括: 1. Epsilon-greedy:簡單易實作,透過固定機率(ε)探索新選項,適合初期測試階段。 2. Thompson Sampling:基於貝葉斯機率,動態調整選擇策略,在real-time traffic routing表現優異。 3. Upper Confidence Bound (UCB):優先選擇置信區間上限高的選項,適合追求statistical significance的場景。

推薦使用以下Python套件快速實作:

- numpy和scipy:處理機率分佈與數學運算

- pymc3或pyro:實現貝葉斯模型的Thompson Sampling

- 自訂類別封裝Bandit邏輯,方便整合到現有系統如Optimizely或VWO

import numpy as np

from scipy.stats import beta

class ThompsonBandit:

def __init__(self, arms):

self.alpha = np.ones(arms) # 成功次數

self.beta = np.ones(arms) # 失敗次數

def select_arm(self):

samples = [np.random.beta(a, b) for a, b in zip(self.alpha, self.beta)]

return np.argmax(samples)

def update(self, arm, reward):

self.alpha[arm] += reward

self.beta[arm] += (1 - reward)

當需要考慮用戶特徵時(如地區、裝置類型),可升級到Contextual Bandit Testing。2025年主流做法是結合reinforcement learning框架(例如TensorFlow Agents),透過以下步驟實現:

1. 特徵工程:將用戶行為轉為特徵向量

2. 模型選擇:線性回歸、神經網路等預測reward

3. 線上學習:即時更新權重,動態調整traffic allocation

import torch

import torch.nn as nn

class ContextualBandit(nn.Module):

def __init__(self, input_dim, arms):

super().__init__()

self.fc = nn.Linear(input_dim, arms)

def forward(self, x):

return torch.sigmoid(self.fc(x))

def select_arm(self, context):

with torch.no_grad():

rewards = self.forward(torch.FloatTensor(context))

return torch.argmax(rewards).item()

在實際部署時需注意: - 冷啟動問題:初期資料不足時,可混合A/B Testing與Bandit算法,例如前24小時純隨機分配,後續逐步切換 - 非穩定環境:若用戶偏好隨時間變化(如節慶效應),需定期重置參數或採用滑動窗口更新 - 技術整合:透過API將Python模型嵌入Amplitude等分析平台,實現dynamic traffic allocation

以電商促銷頁面為例,假設有3種版型: 1. 傳統方法:固定50%/30%/20%流量分配,可能浪費潛在高轉換版型 2. MAB方法:初期探索各版型,後期自動將80%流量導向轉換率最高的版本,提升整體conversion rate達15-30%(根據2025年業界案例)

執行Bandit測試時,除了轉換率,還應追蹤: - 累積遺憾值(Cumulative Regret):與最佳選擇的差距 - 探索比例:確保系統不會過早收斂到局部最佳解 - 模型收斂速度:透過machine learning in testing監控參數穩定度

def calculate_regret(self, best_arm_reward, chosen_arm_reward):

self.cumulative_regret += best_arm_reward - chosen_arm_reward

return self.cumulative_regret

最後提醒,選擇演算法需考量業務場景: - Gittins index適合長期價值最大化(如訂閱制服務) - Epsilon-greedy適合快速迭代的短期活動 - 當有豐富用戶特徵時,Contextual Bandits效果遠超傳統方法

透過Python的靈活性,團隊能快速驗證不同optimization methodologies,這也是為什麼2025年越來越多企業棄用靜態A/B測試,轉向更智慧的Bandit解決方案。

關於Contextual的專業插圖

商務決策最佳化技巧

在商務決策最佳化技巧中,Multi-Armed Bandit Testing (MAB) 已經成為2025年企業提升轉換率與降低決策風險的核心工具。相較於傳統的A/B Testing,MAB透過reinforcement learning動態分配流量,大幅減少regret minimization(遺憾最小化)的過程,讓企業在exploration vs exploitation的權衡中更有效率。舉例來說,當你在Optimizely或VWO平台上運行測試時,傳統A/B測試可能需要數週才能達到statistical significance,但MAB透過Thompson Sampling或Epsilon-greedy等演算法,能即時將更多流量導向表現優異的版本,加速conversion rate optimization (CRO) 的成效。

動態流量分配是MAB的關鍵優勢之一。傳統測試方法通常固定分配50/50的流量,但Multi-Armed Bandits會根據實時數據調整比例。例如,若版本A的轉換率比版本B高出20%,系統會自動將70%流量分配給A,僅保留30%給B進行持續監測。這種real-time traffic routing不僅提升整體轉換率,還能避免將資源浪費在明顯較差的選項上。2025年主流的工具如Amplitude已整合contextual bandit testing,能進一步結合用戶屬性(如地理位置、裝置類型)進行個人化決策,讓exploration-exploitation tradeoff更精準。

在實務操作上,企業可根據需求選擇不同演算法: - Upper confidence bound (UCB):適合追求長期穩定表現的場景,如電商首頁設計。 - Gittins index:常用於金融領域的風險評估,需較複雜的數學模型支援。 - Contextual bandits:當用戶畫像多元時(如串流平台的內容推薦),能結合machine learning in testing動態調整策略。

以台灣電商為例,若要在「限時折扣」與「免運門檻」兩種促銷方案中抉擇,傳統A/B測試可能讓部分用戶看到效益較低的方案,導致營收損失。但透過Multi-Armed Bandit Testing,系統會在首日測試後快速識別「免運門檻」的轉換率高出15%,隨即將80%流量導向該方案,同時保留20%流量持續監測「限時折扣」是否有變化。這種optimization methodologies不僅提升短期營收,長期也能累積更精準的用戶行為數據。

最後需注意,MAB並非萬能解方。當測試變量間的差異極小(如按鈕色調微調),傳統A/B測試的固定分配可能更適合;而涉及digital experimentation的多層次決策(如登入頁與結帳流程的連動優化),則可結合machine learning進階模型。2025年的企業應根據「決策速度需求」與「數據複雜度」選擇工具,例如VWO的dynamic traffic allocation功能就提供直覺化的閾值設定,讓非技術人員也能快速上手。

關於Epsilon的專業插圖

Bandit測試效率評估

Bandit測試效率評估是現代Conversion Rate Optimization (CRO)中不可或缺的一環,尤其在2025年,隨著Multi-Armed Bandit (MAB)技術與machine learning的成熟,企業更需要精準衡量測試效率,才能最大化商業價值。與傳統A/B Testing相比,Multi-Armed Bandit Testing的優勢在於它能動態調整traffic allocation,減少regret minimization(遺憾最小化),同時平衡exploration vs exploitation的權衡。以下我們將深入探討如何評估Bandit測試的效率,並提供實用的優化建議。

首先,統計顯著性(statistical significance)在Bandit測試中的角色與傳統A/B測試不同。傳統方法需要固定樣本量才能得出結論,但Thompson Sampling或Epsilon-greedy等演算法則透過real-time traffic routing動態分配流量,讓表現好的變體獲得更多曝光。這意味著效率評估的關鍵在於conversion rate的提升速度,而非單純的p值。例如,使用Optimizely或VWO這類工具時,可以觀察到Bandit測試能在幾週內快速收斂到最佳變體,而傳統A/B測試可能還卡在樣本收集階段。

其次,exploration-exploitation tradeoff是效率評估的核心。過度探索(exploration)會浪費流量在低效變體上,但過度利用(exploitation)可能錯失潛在更好的方案。2025年主流的解決方案是結合Upper Confidence Bound (UCB)或Gittins index來優化這一平衡。舉例來說,電商網站若採用Contextual Bandit Testing,能根據用戶屬性(如地理位置、裝置類型)動態調整traffic distribution,從而提高整體轉換率。這種方法比隨機分配流量更有效率,尤其適合高流量網站。

在工具選擇上,Amplitude等進階平台已整合reinforcement learning框架,能自動化Bandit測試的效率監控。這些工具會提供regret curves(遺憾曲線)來可視化測試進展,讓團隊一目了然當前策略是否有效。例如,若曲線快速趨於平緩,代表演算法已找到接近最佳的變體;反之,若曲線持續上升,則需調整exploration參數或檢查數據品質。

最後,效率評估也需考量商業目標的優先級。Dynamic traffic allocation雖然能提高轉換率,但若企業同時追求品牌一致性(如避免測試過多極端設計),則需限制演算法的探索範圍。實務上,建議先以小規模流量運行Multi-Armed Bandits測試,確認效率達標後再逐步擴大。例如,金融業者在測試新登入頁面時,可能會設定保守的epsilon值(如0.1),確保大部分用戶看到穩定版本,僅少量流量用於探索新選項。

總的來說,2025年的Bandit測試效率評估已從單純的技術指標,進化為結合machine learning in testing與商業策略的綜合決策。團隊需熟悉optimization methodologies背後的數學原理,並善用工具提供的數據洞察,才能在digital experimentation中保持競爭力。

關於Gittins的專業插圖

AI行銷必學測試法

AI行銷必學測試法:Multi-Armed Bandit Testing的實戰應用

在2025年的AI行銷領域,傳統的A/B Testing已經無法完全滿足企業對Conversion Rate Optimization (CRO)的需求,尤其是當流量分配需要更動態、更即時的決策時。這時候,Multi-Armed Bandit Testing (MAB)就成了行銷人必學的進階測試法。MAB的核心精神在於exploration vs exploitation的平衡,透過machine learning演算法自動調整流量分配,最大化轉換率並最小化regret minimization(遺憾最小化)。

為什麼MAB比傳統A/B Testing更適合AI行銷?

傳統A/B Testing需要固定流量分配(例如50/50),直到達到statistical significance才能決定勝出版本。但MAB採用reinforcement learning概念,動態分配流量給表現較好的變體,例如:

- Thompson Sampling:根據貝氏機率模型,實時更新每個變體的勝率,並分配更多流量給高潛力選項。

- Epsilon-greedy:設定一個探索比例(如10%),其餘90%流量分配給當前最佳版本。

- Upper confidence bound (UCB):優先選擇「不確定性高但可能表現好」的變體,避免過早放棄潛在贏家。

舉例來說,電商網站用Optimizely或VWO執行MAB測試時,系統會自動將80%流量導向高轉換的 landing page,同時保留20%測試其他版本,確保不放過任何優化機會。這種dynamic traffic allocation尤其適合短期促銷活動,因為它能快速反應市場變化。

進階應用:Contextual Bandit Testing

若想進一步提升精準度,可以採用Contextual Bandit Testing,結合用戶畫像(如地理位置、裝置類型)來動態調整策略。例如:

- 旅遊網站發現「台北用戶」偏好紅色按鈕,但「高雄用戶」點擊綠色按鈕的機率更高,系統就會自動匹配最佳版本。

- 金融App利用Amplitude分析用戶行為後,對新客顯示高誘因廣告,對老客則強調忠誠計畫。

實務建議與常見陷阱

1. 工具選擇:2025年主流平台如Optimizely和VWO都已整合MAB功能,但需注意是否支援real-time traffic routing。

2. 流量門檻:MAB需要足夠數據才能發揮效果,若每日流量低於1萬次,建議仍以A/B Testing為主。

3. 冷啟動問題:初期可用Gittins index理論分配少量探索流量,避免演算法因數據不足而偏誤。

4. 指標設定:別只盯住點擊率,應綜合評估conversion rate、客單價等長期價值。

最後,MAB的本質是optimization methodologies與machine learning in testing的結合,2025年的行銷人若能掌握這項技術,就能在digital experimentation中搶佔先機。例如,某美妝品牌透過Thompson Sampling將廣告轉換率提升27%,而成本僅增加5%,這就是AI驅動測試的威力!

關於confidence的專業插圖

數據驅動決策關鍵

在當今數位化競爭激烈的環境中,數據驅動決策已成為企業優化轉換率(Conversion Rate Optimization, CRO)的核心策略。相較於傳統的A/B Testing,Multi-Armed Bandit Testing (MAB) 更能動態分配流量,實現real-time traffic routing,讓企業在exploration vs exploitation之間取得最佳平衡。這種方法不僅能減少regret minimization(遺憾最小化),還能透過machine learning技術,如Thompson Sampling或Upper confidence bound (UCB),快速識別高表現版本,大幅提升決策效率。舉例來說,電商平台若使用Optimizely或VWO這類工具進行dynamic traffic allocation,就能在促銷活動中即時調整頁面設計,避免因statistical significance等待時間過長而錯失商機。

Multi-Armed Bandits的優勢在於它能解決傳統測試的兩大痛點:一是流量浪費,二是反應速度慢。傳統A/B Testing通常需要固定流量分配,直到達到統計顯著性,但MAB則透過reinforcement learning動態調整,例如採用Epsilon-greedy策略時,系統會保留一小部分流量(如10%)用於探索新選項,其餘90%則集中投注於當前最佳版本。這種optimization methodologies特別適合短期活動或快速變化的市場情境。以旅遊網站為例,若測試兩種不同的訂房按鈕顏色,MAB可能在幾天內就將80%流量導向轉換率較高的綠色按鈕,而傳統方法可能還卡在50-50分配等待數據收斂。

進階的Contextual Bandit Testing更進一步結合用戶情境數據(如地理位置、裝置類型),實現個人化優化。例如Amplitude的分析平台能根據用戶行為特徵,動態推薦不同版本的登陸頁面。這種machine learning in testing的應用,讓exploration-exploitation tradeoff更加精準,尤其適合擁有複雜用戶群體的企業。實務上,金融科技公司常利用Gittins index這類演算法,在風險與收益之間找到平衡點,例如測試不同貸款利率方案時,既能探索新客群的接受度,又能最大化現有客群的轉換率。

在執行層面,企業需注意三點關鍵:

1. 工具整合:選擇支援Multi-Armed Bandit Testing的平台(如VWO或Optimizely),並確保與現有數據管道(如CRM或GA4)串接。

2. 指標定義:明確區分「探索階段」與「收割階段」的KPI,前者重視數據多樣性,後者聚焦conversion rate提升。

3. 團隊協作:讓數據科學家與行銷人員共同參與digital experimentation設計,避免演算法偏離商業目標。

最後要提醒,MAB雖強大,但並非萬能。當測試選項間差異極小(如微調字體大小),或需要嚴謹的因果分析時,傳統A/B Testing仍不可取代。實務上,許多企業會採用混合策略:初期用Multi-Armed Bandits快速收斂選項,後期再以A/B測試驗證細部優化。這種分階段作法,正是2025年數據驅動決策最前沿的實踐方式。

關於Optimizely的專業插圖

Bandit測試常見誤區

Bandit測試常見誤區

在進行Multi-Armed Bandit Testing(MAB)時,許多團隊容易陷入幾個關鍵誤區,導致測試結果不如預期,甚至浪費寶貴的流量資源。以下是2025年業界最常見的幾種錯誤,以及如何避免它們的實用建議:

1. 忽略Exploration vs Exploitation的平衡

MAB的核心挑戰在於「探索(exploration)」與「開發(exploitation)」的取捨。常見的錯誤是過度偏向某一方,例如:

- 過度依賴Epsilon-greedy:雖然Epsilon-greedy演算法簡單易用,但固定比例的隨機探索(如設定ε=10%)可能導致高價值變體無法獲得足夠流量。2025年的進階做法是結合Thompson Sampling或Upper Confidence Bound (UCB),動態調整探索比例。

- 過早收斂:有些團隊看到某個變體初期表現較好,就立刻將大部分流量分配給它(例如用Optimizely或VWO的預設設定),卻忽略統計顯著性(statistical significance)不足的問題。建議設定最低探索門檻(如20%流量),確保長期優化空間。

2. 誤解「後悔最小化(Regret Minimization)」的意義

MAB的目標是減少「後悔」(即未選擇最佳選項的累積損失),但許多團隊誤以為這等同於單純追求最高轉換率(conversion rate)。實際上:

- 短期vs長期效益:例如在電商情境中,某個按鈕顏色可能短期提升點擊率,但長期可能降低用戶信任度。需結合Contextual Bandit Testing,納入用戶行為上下文(如瀏覽歷史)來評估真實價值。

- 忽略非線性回報:傳統A/B Testing假設效果是靜態的,但MAB需考慮動態變化(如季節性因素)。2025年領先企業會用Reinforcement Learning模型,即時調整流量分配策略。

3. 低估演算法選擇的複雜性

許多平台(如Amplitude)提供「一鍵啟用」的MAB功能,但預設演算法未必適合所有場景:

- Gittins Index的適用性:雖然理論上最優,但計算成本高,更適合高價值決策(如金融產品定價)。多數情境下,Thompson Sampling或Epsilon-decay(隨時間降低探索率)是更務實的選擇。

- 忽略情境特徵:若測試涉及多維度變數(如用戶分群),需採用Contextual Bandits而非傳統MAB。例如,旅遊網站可能對「商務客」和「休閒客」展示不同廣告,這時單純的流量分配(traffic allocation)就不夠精準。

4. 混淆MAB與傳統A/B Testing的解讀方式

- 統計顯著性的迷思:MAB不像A/B Testing需要達到95%信心水準才決策,但這不代表可以忽略數據品質。建議監控動態信心區間,並設定「安全停止規則」(例如當某變體勝率超過80%且累積樣本足夠時才擴大分配)。

- 流量分配的透明度:工具如VWO可能隱藏底層演算法邏輯,導致團隊無法驗證結果。2025年最佳實踐是要求平台提供real-time traffic routing的詳細日誌,並定期人工抽查。

5. 未整合Machine Learning進階應用

MAB本質是Machine Learning in Testing的應用,但許多團隊仍停留在「測試工具」思維:

- 特徵工程的重要性:例如在媒體業,若僅測試「標題A vs 標題B」,卻未考慮用戶興趣標籤,可能錯失個人化機會。應結合用戶畫像(如Amplitude的用戶分群)來強化Contextual Bandits。

- 模型再訓練週期:市場環境變化加速,2025年建議每週檢視一次bandit模型表現,並重新評估參數(如UCB的探索係數)。

實務案例:電商首頁優化

某台灣服飾品牌在2025年Q1使用MAB測試首頁輪播圖,初期犯了一個典型錯誤:將80%流量分配給CTR較高的「折扣促銷圖」,結果發現該圖雖提升點擊,卻降低高客單價商品的曝光。後續調整為動態流量分配,並加入「用戶購買力」作為上下文特徵,最終整體GMV提升12%。這案例凸顯單純追求轉換率(CRO)的盲點,需結合Conversion Rate Optimization的宏觀目標。

總之,避免這些誤區的關鍵在於:

- 理解MAB與傳統A/B Testing的本質差異

- 根據業務目標選擇合適演算法(如Thompson Sampling vs UCB)

- 持續監控並迭代模型,而非「設定後不理」

關於VWO的專業插圖

電商轉換率提升術

在電商領域,轉換率提升一直是經營者的核心目標,而Multi-Armed Bandit Testing (MAB) 正是2025年最受矚目的進階優化技術之一。相較於傳統的A/B Testing,MAB透過強化學習 (Reinforcement Learning) 動態分配流量,不僅能減少統計顯著性 (Statistical Significance) 的等待時間,還能即時調整探索與利用 (Exploration vs Exploitation) 的平衡,讓你的電商平台在最短時間內找到最佳轉換策略。舉例來說,當你在測試「結帳頁面的按鈕顏色」時,傳統A/B測試可能需要固定分配50%流量給每個版本,而MAB則會根據即時數據,自動將更多流量導向表現較好的版本,同時保留少量流量探索其他可能性,這種動態流量分配 (Dynamic Traffic Allocation) 能大幅降低遺憾最小化 (Regret Minimization) 的風險。

Thompson Sampling 和 Epsilon-greedy 是MAB中最常用的兩種演算法,它們各自適合不同的場景。Thompson Sampling基於貝葉斯統計,會為每個選項計算一個概率分佈,再根據分佈隨機抽樣來決定流量分配,特別適合轉換率優化 (CRO) 這種二元結果的場景;而Epsilon-greedy則是以固定概率(例如10%)進行隨機探索,其餘時間選擇當前最佳選項,優點是實作簡單,適合剛接觸MAB的團隊。2025年主流工具如 Optimizely 和 VWO 都已內建這些演算法,甚至能結合上下文老虎機 (Contextual Bandit Testing),根據用戶屬性(如地理位置、瀏覽紀錄)動態調整測試策略,讓個人化體驗更上一層樓。

實務上,電商該如何選擇MAB策略?以下是幾個關鍵考量點:

1. 流量規模:小型電商(每日流量低於1萬)建議從Epsilon-greedy入手,避免過度分散流量;中大型平台則可採用 Upper Confidence Bound (UCB) 或 Gittins Index 這類進階演算法,它們在長期優化上更穩定。

2. 變動頻率:如果你的商品頁面常隨季節調整(例如服飾電商),Contextual Bandits 能快速適應新情境,比起傳統A/B測試省下至少30%的學習時間。

3. 技術門檻:若團隊已有機器學習 (Machine Learning) 基礎,可自建MAB系統整合至CDP平台;否則直接使用 Amplitude 等現成工具,其視覺化報表能直觀比較各版本的轉換率 (Conversion Rate) 變化。

舉個實際案例:某台灣美妝電商在2025年Q1測試「首頁輪播圖」時,採用Thompson Sampling的MAB方法,僅用2週就鎖定最佳版本(傳統A/B測試需4週),最終轉換率提升19%。關鍵在於他們設定了清晰的優化目標(點擊率 vs 購買率),並透過實時流量路由 (Real-time Traffic Routing) 優先將高價值用戶(過去30天有加購行為)導向最有可能轉換的版本,這種結合用戶分群的數位實驗 (Digital Experimentation) 手法,正是當前頂尖電商的標配。

最後要提醒,MAB雖強大,但實驗設計仍是成敗關鍵。例如:

- 避免同時測試過多變數(建議不超過3個),否則會加劇探索與開發權衡 (Exploration-Exploitation Tradeoff) 的難度。

- 定期監控流量分佈 (Traffic Distribution),確保系統沒有因早期隨機波動而「偏食」某個次優版本。

- 在促銷旺季(如雙11)可暫時切回傳統A/B測試,因短期爆量流量可能干擾MAB的學習機制。

透過這些策略,你的電商不僅能活用Multi-Armed Bandits 的即時優勢,還能結合機器學習測試 (Machine Learning in Testing) 持續迭代,在2025年的激烈競爭中保持轉換率成長動能。

關於Amplitude的專業插圖

動態流量分配策略

在 Multi-Armed Bandit Testing 的實務應用中,動態流量分配策略 是提升 Conversion Rate Optimization (CRO) 效率的核心技術。傳統的 A/B Testing 採用固定流量分配比例(如50/50),但這種靜態方法可能導致資源浪費,因為表現較差的變體仍佔用大量流量。相較之下,Multi-Armed Bandit (MAB) 通過 machine learning 動態調整流量分配,優先將更多用戶導向高轉換率的變體,同時保留少量流量探索其他選項。這種 exploration-exploitation tradeoff 的平衡,正是 MAB 的優勢所在。

目前業界常用的 動態流量分配策略 可分為以下幾類:

1. Thompson Sampling:基於貝葉斯統計的演算法,透過模擬每支「手臂」(變體)的轉換率分佈,動態分配流量。例如,若變體A的模擬轉換率在80%情況下優於變體B,則將80%流量分配給A。這種方法能有效 minimize regret,尤其適合轉換率波動大的場景。

2. Epsilon-greedy:簡單卻實用的策略,設定一個小概率值(如ε=10%)隨機探索其他變體,其餘90%流量則分配給當前最佳選擇。雖然容易實作,但在 statistical significance 不足時可能過早收斂。

3. Upper Confidence Bound (UCB):透過計算每個變體的轉換率信心區間上限,優先選擇潛力最高的選項。這種方法特別適合初期資料稀疏的階段,能加速找到最優解。

以工具層面來看,Optimizely 和 VWO 等平台已整合 MAB 功能,允許行銷團隊直接套用 Thompson Sampling 或 Epsilon-greedy 策略。例如,電商網站可用 VWO 測試「結帳按鈕顏色」,系統會根據即時數據自動將70%流量導向紅色按鈕(若其轉換率較高),並保留30%測試其他顏色。這種 real-time traffic routing 不僅縮短測試週期,還能最大化收益。

進階的 Contextual Bandit Testing 更進一步結合用戶特徵(如地理位置、瀏覽行為),實現個人化流量分配。舉例來說,Amplitude 的 reinforcement learning 模型能辨識「iOS用戶偏好藍色按鈕,Android用戶偏好綠色」,從而動態調整展示邏輯。這種情境化策略比傳統 MAB 更能精準捕捉細分受眾的偏好。

實務上,選擇動態策略需考量兩大關鍵:

- 測試目標:若目標是快速提升短期轉換率,Thompson Sampling 或 UCB 較適合;若需長期累積數據(如新功能驗證),則可降低探索率(如ε=5%)。

- 流量規模:小型網站(日流量<1萬)建議採用 Epsilon-greedy 避免過度分散;大型平台則可運用 Gittins index 等複雜模型,精細化分配資源。

最後需注意,dynamic traffic allocation 雖能優化轉換率,但仍需監控 statistical significance。例如,當某變體流量占比超過90%時,應手動介入檢查是否因隨機波動導致偏差。結合 machine learning in testing 與人工覆核,才能確保策略的穩健性。

關於Optimization的專業插圖

Bandit測試工具推薦

Bandit測試工具推薦

在2025年的今天,Multi-Armed Bandit Testing(MAB)已經成為A/B Testing的主流進化版,尤其適合需要快速優化Conversion Rate Optimization (CRO)的團隊。如果你正在尋找能結合machine learning與reinforcement learning的測試工具,以下幾款頂尖平台絕對值得考慮:

-

Optimizely

Optimizely是目前市場上最成熟的Multi-Armed Bandit Testing工具之一,支援多種演算法,包括Thompson Sampling和Epsilon-greedy。它的強項在於dynamic traffic allocation,能根據實時數據自動調整流量,最大化exploration vs exploitation的效率。例如,當某個版本的轉換率明顯優於其他版本時,Optimizely會逐步將更多流量分配到勝出版本,同時保留少量流量繼續探索其他可能性,有效降低regret minimization。 -

VWO

VWO的Contextual Bandit Testing功能特別適合電商或內容平台,它能根據用戶行為(如瀏覽紀錄、地理位置)動態分配測試版本,實現real-time traffic routing。VWO還提供直觀的儀表板,讓非技術人員也能輕鬆監控statistical significance與traffic distribution的變化。 -

Amplitude

Amplitude以machine learning in testing見長,其核心演算法結合了Upper confidence bound (UCB),特別擅長處理高維度數據(如多變量測試)。如果你需要同時測試數十個變因(例如標題、圖片、按鈕顏色),Amplitude能透過exploration-exploitation tradeoff快速收斂到最佳組合,大幅縮短傳統A/B測試的週期。

選擇工具的關鍵考量

- 演算法靈活性:不同場景適合不同演算法。例如,Thompson Sampling在初期數據不足時表現優異,而Gittins index則適合長期運行的實驗。

- 整合性:工具是否支援API串接現有CRM或CDP系統?例如,Optimizely能直接對接Salesforce,實現digital experimentation閉環。

- 成本效益:部分工具按流量計費,若測試規模較大,可優先考慮Amplitude這類以事件為基礎的定價模式。

實際應用案例

假設你經營一個訂閱制媒體平台,想測試三種不同的付費方案頁面。傳統A/B測試需均分流量,但透過Multi-Armed Bandits工具如VWO,系統會在首週根據用戶點擊行為自動傾斜流量(例如將70%分配給表現最佳的方案),同時保留exploration空間以避免局部最優。這種方法在2025年已被證實能提升至少20%的conversion rate,遠勝傳統固定流量分配。

最後,別忘了評估工具的optimization methodologies是否透明。有些平台會隱藏演算法細節,導致團隊難以解讀結果。建議優先選擇提供完整報告與解釋性儀表板的工具,例如Optimizely的「演歷程追蹤」功能,能清晰呈現每次流量調整的邏輯。

關於Reinforcement的專業插圖

機器學習應用實例

在Multi-Armed Bandit Testing中,機器學習應用實例已經成為提升Conversion Rate Optimization (CRO)的關鍵技術。相較於傳統的A/B Testing,Multi-Armed Bandits (MAB)透過reinforcement learning動態調整流量分配,大幅降低regret minimization的影響,讓企業能在exploration vs exploitation之間找到最佳平衡。舉例來說,Thompson Sampling和Epsilon-greedy這兩種演算法,就是透過machine learning in testing來即時優化traffic allocation,確保高轉換率的版本能獲得更多曝光。

Thompson Sampling是一種基於貝葉斯統計的演算法,特別適合處理exploration-exploitation tradeoff問題。它的核心思想是透過機率分布來模擬每支「手臂」(例如網頁的不同版本)的表現,並根據這些分布來動態分配流量。舉個實際案例,電商平台在2025年使用Optimizely或VWO這類工具時,可以透過Thompson Sampling自動將更多流量導向轉換率高的商品頁面,同時保留一部分流量測試其他潛在優化方案。這種方法不僅能提高conversion rate,還能避免傳統A/B Testing因固定流量分配而造成的機會成本。

另一個熱門的演算法是Upper confidence bound (UCB),它透過計算每支手臂的「信心上限」來決定流量分配。UCB特別適合那些需要快速收斂結果的場景,例如限時促銷活動。與Thompson Sampling不同的是,UCB更注重statistical significance,確保每次探索都能最大化資訊價值。2025年許多企業在digital experimentation中發現,結合Contextual Bandit Testing(考慮用戶上下文資訊的進階版MAB)能進一步提升精準度。例如,旅遊網站可以根據用戶的瀏覽歷史,動態調整首頁推薦內容,從而優化traffic distribution。

Epsilon-greedy則是另一種簡單但有效的策略,它以固定機率(例如10%)進行隨機探索,其餘時間則選擇當前表現最好的版本。這種方法雖然不如Thompson Sampling或UCB聰明,但在資源有限或測試初期階段非常實用。2025年的Amplitude等數據分析平台,就經常將Epsilon-greedy整合到他們的optimization methodologies中,幫助中小企業快速驗證假設。不過要注意的是,過高的探索率(epsilon值)可能導致資源浪費,因此需要根據業務需求動態調整。

最後,Gittins index是一種理論上最優的MAB解決方案,但由於計算複雜度高,實際應用較少。不過隨著machine learning技術的進步,2025年已經有部分高階工具開始嘗試整合近似算法,讓企業能在real-time traffic routing中實現近乎最佳的流量分配。總的來說,Multi-Armed Bandit Testing的機器學習應用實例不僅限於上述幾種演算法,而是可以根據業務場景靈活組合。例如,結合reinforcement learning的進階版MAB,能進一步處理多變數、多目標的優化問題,為企業帶來更高的ROI。

關於learning的專業插圖

ROI最大化測試法

在數位行銷領域,ROI最大化測試法的核心就是透過Multi-Armed Bandit (MAB)技術來動態分配流量,相較於傳統A/B Testing的固定分流,MAB能根據即時數據調整traffic allocation,減少無效曝光的浪費。以2025年主流工具如Optimizely或VWO為例,它們的Contextual Bandit Testing模組已整合強化學習(Reinforcement learning),能自動判斷哪個版本的conversion rate更高,並將更多流量導向勝出版本。這種方法特別適合電商促銷活動,例如當你同時測試三種不同的折扣方案(如8折、滿千送百、限時免運),MAB會在第一週就發現「滿千送百」的轉換率高出30%,隨即將80%流量分配給該方案,而非像傳統A/B測試必須等到統計顯著性(statistical significance)達標才調整。

具體來說,ROI最大化的關鍵在於平衡exploration and exploitation。例如使用Thompson Sampling演算法時,系統會基於貝氏統計動態計算各版本的勝率,並隨機抽樣分配流量——表現越好的版本獲得越多曝光,但仍有微小機率探索其他選項。這種做法能有效降低regret minimization(遺憾最小化),避免「過早收斂」錯失潛在黑馬。2025年台灣某美妝品牌就透過Amplitude的Upper confidence bound模型,在母親節檔期實現23%的營收成長:系統偵測到「滿額贈旅行組」的點擊率雖非最高,但客單價卻比「第二件五折」高出1.8倍,於是逐步將流量從後者轉移,最終讓整體ROI提升40%。

進階操作上,建議結合Gittins index與machine learning in testing。前者是英國數學家提出的動態決策框架,能根據歷史數據計算每個版本的「潛在價值指數」;後者則透過神經網路分析用戶行為模式(如來自FB廣告的用戶偏好影片素材,而Google Ads用戶傾向靜態圖片)。例如金融業者在推廣信用卡時,可利用Contextual Bandits區分客群:年輕族群對「現金回饋」反應熱烈,而中高齡客戶更關注「機場接送」,系統會依據用戶輪廓即時切換版本,實現real-time traffic routing。相較於傳統分群測試需獨立跑數週數據,這種方法僅需3~5天就能產出穩定結果。

實務中需注意兩大陷阱:首先是epsilon-greedy參數設定。雖然固定保留5%~10%流量隨機探索(exploration vs exploitation)能避免局部最優化,但若初始樣本數不足(如每日流量低於1,000人),反而會拖慢收斂速度。其次是dynamic traffic distribution的透明度問題——部分團隊過度依賴黑箱演算法,卻忽略監控各版本的輔助指標(如退貨率、客訴量)。2025年已有工具如VWO新增「影響力儀表板」,能並列顯示轉換率與利潤變化,例如某健身APP發現「年費方案」的註冊率雖低於「月費制」,但LTV(客戶終身價值)高出3倍,便手動加權該版本的流量權重。這顯示Conversion Rate Optimization (CRO)不能只看短期轉換,更要透過MAB的彈性機制兼顧長期獲利。